ChatGPTは、OpenAIが開発した最新のテキスト生成系AIツールです。この革新的な技術は、自然言語処理を駆使して、ユーザーの質問に自然な文章で回答を提供します。その利便性から、多くの企業がChatGPTを活用してビジネスに応用しようとしています。

しかし、ChatGPTの利用にはセキュリティ上のリスクが存在します。機密情報や個人データの漏洩や、誤った情報の提供、さらにはサイバー攻撃への悪用などが考えられます。このため、企業はChatGPTを安全に運用するためのセキュリティ対策を講じる必要があります。

ChatGPTのセキュリティリスクは必要?

ChatGPTを利用する際に懸念されるセキュリティリスクはいくつかあります。

まず、機密情報や個人データの漏洩が挙げられます。従業員がChatGPTを通じて情報を送信する際、

意識せずに機密情報を外部に流出させてしまう可能性があります。

例えば、内部的な売上目標や製品別の売上状況など、外部に公開されていない情報をチャット上で入力してしまうことが考えられます。

また、ChatGPTの回答が誤った情報を提供する可能性もあります。AIが自動生成した文章はあくまで機械的なものであり、正確性が保証されているわけではありません。誤った情報に基づいて意思決定を行うことで、企業に悪影響を及ぼす可能性があります。

さらに、ChatGPTは悪意ある者によってサイバー攻撃に悪用される可能性もあります。例えば、フィッシング詐欺文書の生成や、マルウェアや攻撃コードの生成などが考えられます。また、ChatGPTを装った偽サイトが公開され、ユーザーが個人情報を入力してしまうといったリスクも存在します。

これらのセキュリティリスクに対処するためには、企業は適切なセキュリティ対策を講じる必要があります。

ChatGPTへの攻撃事例

ChatGPTへの攻撃方法として、注目されているのがプロンプト・インジェクションです。この攻撃については、以下のリンクにて詳しく解説しています。

プロンプト・インジェクションとは・・・AIチャットボットに対する攻撃の事

AI/MLに対する一般的な攻撃方法として、データポイズニング攻撃があります。

この攻撃はAIのアルゴリズムを悪用し、偽造された訓練データを混入させることで学習モデルを破壊し、AIに対し特定の偏見や虚偽の情報を刷り込む手法です。

今後、研究者や攻撃者が、ChatGPTのアルゴリズムを破壊する手法を見つける可能性があります。

人気掲示板のRedditでは、ChatGPT公開直後に、プログラムに設定されたコンテンツ制限を「解除」する方法であるDAN(Do Anything Now)が公開されています。

2023年3月には、セキュリティ研究者がChatGPTの認証プロセスに存在するバグを報告し、修正が行われています。このバグは、「Web Cache Deception」(Webキャッシュ詐欺)と呼ばれる種類の攻撃を可能にするものであり、攻撃者によるアカウント奪取につながるものでした。

他にも、複数のChatGPT APIにおける脆弱性が研究者によって報告され、OpenAIによる対応が行われています。

2023年4月、OpenAIはバグ・バウンティプラットフォームBugcrowdと提携し、報奨金最大2万ドルのバグ・バウンティプログラムを開始しました。

大規模言語モデルを利用したAIチャットボットは非常に便利で有益な技術です。

一方でサイバー攻撃やマルウェア作成への悪用等、セキュリティ面での新たな課題も浮上しています。

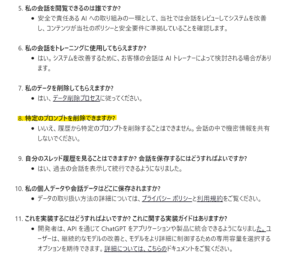

ChatGPTが推奨する入力NG内容とは?

ChatGPTには、以下のような情報を入力することは避けるべきです。

・顧客管理のために、顧客データの一部をGPTに入力して表を作成させる

ChatGPTを安全に使用するための簡単なセキュリティ対策

ChatGPTを使用する際は、以下のようなセキュリティ対策を取ることで安全性を高めることができます。

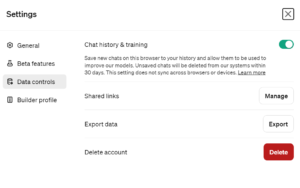

チャット履歴の記録・学習をオフにする

-

- ChatGPTの設定で、チャット履歴の記録・学習をオフにすることができます。これにより、入力された情報が外部に漏れるリスクを減らすことができます。具体的には下記の通りです。

・「Settings」を押下

「Chat history & training」をONにすれば完了です。

利用ポリシーを策定し社内で共有する

-

- ChatGPTの安全な使用方法についてのポリシーを作成し、社内で共有することが重要です。これには、ChatGPTの使用シーンや入力内容、出力テキストの活用方法などが含まれます。

ChatGPT Team Planへ切り替えをする

-

- ChatGPT Plusへ加入されている企業は多いかと思います。

- しかしながら最近では最初からAini学習されなくなるようなプランがでました。

- それがChatGPT Team Planです。しかも社内同士でのアカウントの共有がより簡潔に

- できるため、安全対策を考える事自体が面倒だという方は下記記事もご参照ください。

【ChatGPT Team Plan】のメリット~使い方!法人向けの高性能なGPT-4プランを徹底解説

これらの対策により、ChatGPTをより安全に活用することが可能になります。

実際に使えるChatGPTのセキュリティ対策

1. 公式サイト・アプリを間違えない

信頼できる公式のサイトやアプリからのみAIモデルにアクセスしましょう。OpenAIの公式サイトは「https://chat.openai.com/」です。

URLが僅かに異なる偽サイトに注意が必要です。公式以外のアプリがインストールを促した場合も危険です。疑わしい場合は信頼できる情報源で確認しましょう。

アプリの公式版については以下で解説しています。

ChatGPTのスマホ向けアプリの本物はどれ?DL方法や使い方についても

2. 機密情報の取り扱い制限

ウェブ版のAIモデルでは機密情報や個人を特定できる情報を絶対に入力してはいけません。情報漏えいのリスクを最小限に抑えるため、機密情報は別の管理された環境で扱うべきです。

3. チャット履歴の無効化

「Data Controls」から「Chat history & training」をオフにすれば、チャット履歴が保存されなくなります。アカウントが不正アクセスされても、機密情報が含まれる過去の履歴漏えいリスクを大幅に下げられます。

4. API版やエンタープライズ版の利用

ビジネス利用ではウェブ版ではなく、API版やChatGPT Enterpriseプランの利用を検討しましょう。これらのサービスでは入力したプロンプトが学習に使われず、機密情報漏えいリスクが低くなります。また、社内の専門知識をAIに学習させられます。

5. クラウドサービス活用

Microsoft AzureのOpenAI Serviceなどのクラウドサービスを利用すれば、高度なセキュリティ環境の下でAIモデルを安全に活用できます。24時間体制の専門家監視や、アクセス制限機能が備わっています。

6. セキュリティシステム導入

企業内で利用する場合は、DLP(Data Loss Prevention)などのセキュリティシステムと併せて運用することをおすすめします。DLPは機密情報の送信を検知して制限できるため、情報漏えいリスクを大幅に下げられます。

7. 出力内容の確認

AIモデルの出力には、誤った事実、編向きのかけた表現、個人攻撃、違法行為助長など、倫理的に問題のある内容が含まれる可能性があります。プログラムコードにもセキュリティホールやバグが潜んでいるかもしれません。出力内容を徹底的に確認し、必要に応じて修正しましょう。

その他にも、ユーザー認証強化、操作ログ保存、ネットワーク分離など、環境に合わせた対策を実施することが重要です。人的ミスへの注意を怠らず、様々な対策を組み合わせて総合的にセキュリティを確保する必要があります。

ChatGPTのセキュリティ対策は?マニュアル編

ChatGPTを安全に運用するためには、以下のセキュリティ対策が有効です。

1. ポリシーの策定と従業員への周知

まず、ChatGPTの利用に関するポリシーを明確に策定し、従業員に周知することが重要です。ポリシーでは、機密情報や個人データの入力を禁止することや、生成データの正確性や著作権の確認を従業員に求めることが考えられます。従業員がChatGPTを利用する際には、企業のポリシーを遵守するよう徹底する必要があります。またChatGPTによるサイバー攻撃や悪用の事例や危険性を知らせることも必要です。

2. 機密情報の入力禁止

企業では、機密情報や個人データの入力を禁止することが重要です。従業員には、ChatGPTを通じて機密情報を送信しないよう指導し、意識を高める必要があります。さらに、技術的な制限を設けることで、機密情報の漏洩を防止することも有効です。

3. 生成データの正確性と著作権の確認

ChatGPTの回答は自動生成されるため、正確性が保証されているわけではありません。企業では、従業員が生成データの正確性を確認するよう指導する必要があります。また、著作権に関する法的な問題を回避するためにも、従業員には生成データの使用に関して著作権の確認を行うよう促すことが重要です。

4. 対話履歴のログ管理

ChatGPTの対話履歴はログとして保存されることがあります。企業では、対話履歴のログ管理を徹底することが重要です。ログの適切な管理により、セキュリティ上のリスクを軽減することができます。

5. セキュリティ対策の定期的な監査

セキュリティ対策は定期的に監査することが重要です。企業は、ChatGPTの利用に関するセキュリティ対策の状況を確認し、必要な改善を行うことで安全性を確保することができます。

以上のセキュリティ対策を講じることで、企業はChatGPTを安全に運用することができます。セキュリティリスクを最小限に抑え、ビジネスの効率化や情報提供の向上を実現するために、セキュリティ対策を積極的に取り組むことが重要です。

6.データの保護

ChatGPTは、学習したテキストデータに基づいて会話を生成するため、データの保護が重要です。

データの保護には、データの暗号化やアクセス制限などの技術的な対策だけでなく、データの取得や利用に関する法的な規制や倫理的なガイドラインなどの社会的な対策も必要です。

7.モニタリングと監査

ChatGPTは、相手の感情や意図に応じて会話を変えることができるため、モニタリングと監査が重要です。モニタリングと監査には、ChatGPTの生成した会話やメディアの内容や品質を確認することだけでなく、ChatGPTの利用状況や効果測定を行うことも必要です。

情報漏洩しないためにもオプトアウト申請は必ずしよう

オプトアウト申請をご存知ですか?

高度な文章能力と使い勝手の良さで、ChatGPTは多くの業務や日常生活に取り入れられてきました。簡単なアカウント作成で無料アクセスが可能なこのツールは、多くの方に日常で利用されているかもしれません。

しかし、ChatGPTの「オプトアウト申請」についての理解が不足していると、気づかないうちに機密情報が学習データとして取り込まれるリスクが考えられます。ChatGPTがデータを学習しないための方法や、オプトアウトの申請は重要です。

オプトアウト申請を行う事で自身の入力した情報を学習されずに済むことができますので、

企業など仕事でChatGPTを活用する方は必ずこのオプトアウト申請をするようにしましょう。

ChatGPTのオプトアウト申請の手順

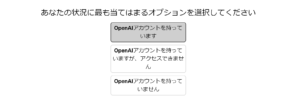

①オプトアウトフォームを開きます。

②自身のアカウントステータスを押下します。

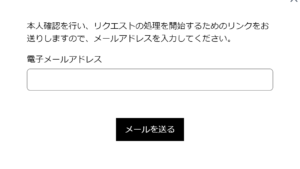

③メールアドレスを入力します。

最後にメールが飛んできますので、同意してリクエスト送信wすれば完了です。

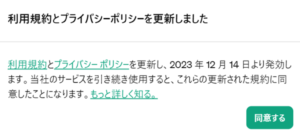

ChatGPTのプライバシーポリシーが改定(2023年12月14日より施行)

ChatGPTのプライバシーポリシーが改定(2023年12月14日より施行)することになりました。

改変内容は下記の通りです。。

利用規約の変更点

- 個別のビジネス条件: ChatGPT EnterpriseとAPIの利用に関連する利用規約のセクションを削除し、これらのサービスに適用される新しい取引条件を作成しました。

- 仲裁手順の更新: 紛争解決のための仲裁手順の一部を更新しました。

- 可読性の向上: 利用規約の一部を再編成し、より明確で理解しやすいものにしました。

プライバシーポリシーの変更点

- 収集する個人情報: イベントやアンケート参加時など、ユーザーが提供した情報の収集に関する明確化。

- ビジネスアカウント: ChatGPT Enterpriseとチームアカウントの管理者がアクセスできる情報の種類についての情報提供。

利用規約の対象サービス

利用規約は、ChatGPT、DALL・E、および個人使用目的のOpenAIの他のサービスに適用されます。ビジネス規約は、ChatGPT EnterpriseやOpenAI APIなど、企業使用目的のサービスに適用されます。

個別ビジネス規約の理由

ビジネスや組織のユーザーは、データ処理要件やチーム管理など、個人ユーザーとは異なるニーズを持っています。個別の取引条件は、これらの特定の側面に対応するために設計されています。

仲裁手続きの変更

紛争の仲裁方法が修正され、明確化されました。例えば、裁判外紛争解決サービスの変更や、国家仲裁および調停の手順の更新などが含まれます。

おそらく先日のOpenAI DevdayでのChatGPTシールド=紛争の保証等をするという発表があったようにその影響を受けていると考えます。OpenAI Devdayの詳細は下記記事をご覧ください。

新機能GPTsなど!OpenAI DevDayとは? 2023年11月7日レポート総まとめ

まとめ

ChatGPTは革新的なテキスト生成系AIツールであり、多くの企業がその利便性に注目しています。しかし、利用にはセキュリティ上のリスクが存在し、企業はこれを十分に認識し、適切なセキュリティ対策を講じる必要があります。

機密情報や個人データの漏洩、誤った情報の提供、サイバー攻撃への悪用など、セキュリティリスクは様々です。企業はポリシーの策定と従業員への周知、機密情報の入力禁止、生成データの正確性と著作権の確認、対話履歴のログ管理、定期的なセキュリティ監査といった対策を講じることで、安全にChatGPTを運用することができます。

セキュリティ対策を軽視せず、ChatGPTの利便性を最大限に活かしつつ、ビジネスの効率化を図ることが重要です。ChatGPTを適切に活用することで、企業は情報提供の向上や競争力の強化を実現できるでしょう。

参考URL

- OpenAI│What is ChatGPT? https://openai.com/blog/chatgpt

- ChatGPT – OpenAI https://openai.com/chatgpt

- What Is OpenAI’s ChatGPT, And How Can You Use It … https://www.weetechsolution.com/blog/what-is-openais-chatgpt-and-how-can-you-use-it

- What is ChatGPT by OpenAI – Explained! – GeeksforGeeks https://www.geeksforgeeks.org/what-is-chatgpt/

- OpenAI Platform https://platform.openai.com/docs/chatgpt-education

趣味:業務効率化、RPA、AI、サウナ、音楽

職務経験:ECマーチャンダイザー、WEBマーケティング、リードナーチャリング支援

所有資格:Google AI Essentials,HubSpot Inbound Certification,HubSpot Marketing Software Certification,HubSpot Inbound Sales Certification

▼書籍掲載実績

Chrome拡張×ChatGPTで作業効率化/工学社出版

保護者と教育者のための生成AI入門/工学社出版(【全国学校図書館協議会選定図書】)

突如、社内にて資料100件を毎月作ることとなり、何とかサボれないかとテクノロジー初心者が業務効率化にハマる。AIのスキルがない初心者レベルでもできる業務効率化やAIツールを紹介。中の人はSEO歴5年、HubSpot歴1年