近年、生成AIの技術進化が加速しており、ChatGPTの登場以降、多くの企業が続々と独自の大規模言語モデル(LLM)を投入しています。この熾烈な開発競争の中、生成AI分野の先駆けであるOpenAIの動向が大きな注目を集めています。

OpenAIは2024年5月13日(日本時間14日午前2時)から、「GPT-4o」の最新アップデートに関するライブ配信イベント「OpenAI Spring Update」を開催されました。その内容をこの記事でまとめていますので是非、ブクマ推奨します!

大きな発表はGPT-2で話題になっていた、最新モデルGPT-4oでした。

前回の大きな発表は下記記事をご覧ください!雰囲気がつかめるはずです!

新機能GPTsなど!OpenAI DevDayとは? 2023年11月7日レポート総まとめ

この記事はこんな人におすすめ

・GPT-4oの使い方を知りたい

・「OpenAI Spring Update」の内容を知りたい

・GPT-4oの活用事例を知りたい

GPT-4o(フォーオー)の発表はOpenAI Spring Updateから

OpenAIより引用

OpenAIは2024年5月13日(日本時間14日午前2時)から、「ChatGPT」と「GPT-4」の最新アップデートに関するライブ配信イベント「OpenAI Spring Update」を開催されました。このイベントはGoogleの開発者会議「Google I/O」の前日に行われます。GPT-4o(フォーオー)はここから発表がありました。

・視聴方法

「OpenAI Spring Update」のライブ配信は、OpenAIの公式ウェブサイト(openai.com)から視聴できます。

視聴は下記から!※現在は配信が終了していますが、アーカイブで見ることが可能です!

「OpenAI Spring Update」発表内容について(要約だけ見たい人版)

OpenAIの新発表は、AIの世界に革新的な変化をもたらしました。

1思考力の向上

2思考速度の高速化

3視覚モデルの進化

4ボイスモデルの強化

5感情理解の実現

- 思考力の向上

- GPT-4oは圧倒的な能力を示し、世界最高レベルのチャットボットであることが確認されました。

- 思考速度の高速化

- GPT-4oは非常に高速で、実用面でも優れたパフォーマンスを発揮します。

- 視覚モデルの進化

- 1秒単位での認識が可能で、手書き文字や動画の理解、日本語OCRの性能が大幅に向上しました。

- ボイスモデルの強化

- イントネーションや歌声、ロボットのような声の生成が可能になり、映画「Her」を彷彿とさせます。

- 感情理解の実現

- AIが感情を理解しているのか、単に真似ているのかという哲学的な議論を呼ぶほどの感情表現が可能になりました。

「OpenAI Spring Update」発表内容について

噂では「GPT-4.5」が来るのでは?とされていましたが実際には違いました。

発表された内容は以下の通りです。

1. 無料ユーザーへの解放

2.ChatGPTデスクトップアプリの登場

3. 最新モデル「GPT-4o」 の発表

1つずつ解説していきます。

ChatGPTの大幅な機能が無料ユーザーへ解放

無料版ChatGPTが大幅アップグレードしました!具体的には有料版でしか使えなかった機能が一部有料版でも使えるようになります!

Youtubeより引用

- GPT-4oとGPTsが無料で利用可能に

- ウェブ情報取得・データ分析機能を追加

- 写真解析、ファイルアップロード、GPTストアも無料で使えます

分析機能についてはこちらから!

ChatGPTのAlways expand code output(Advanced data analysis)(Code Interpreter)の導入~使い方!

写真解析機能についてはこちら!

ChatGPTの音声・画像認識機能、GPT-4V(ビジョン)がエグイ!導入方法~使い方を徹底解説

GPTストアについては下記STEPで勉強しましょう!

【有料ユーザー向け】

【収益化可能】GPT Storeとは?使い方~いつオープンかまで徹底解説

【無料ユーザー向け】

【完全版】GPTs(GPT Builder)とは?使い方を徹底解説!おすすめの活用事例~注意点も。

ジャンル別おすすめのGPTs(GPT Builder)55選と活用事例!GPT Storeでのおすすめも紹介!実際に試してみた

ChatGPTデスクトップアプリの登場

OpenAI社は5月13日、ChatGPTのデスクトップアプリ版をリリースすると発表いたしました。まずは有料会員向けにMac版を提供し、数週間以内に無料ユーザー向けにも配信する予定です。Windows版につきましては、2024年後半のリリースを予定しているとのこと。

この新しいアプリはブラウザ版の機能を拡張し、PCでの作業にシームレスに統合できるよう設計されています。たとえば、キーボードショートカット (Option + Space) を押すことで、簡単にChatGPTに質問ができ、スクリーンショットの撮影後、すぐにAIとの会話も容易にできます。

デスクトップアプリについての特徴は、ChatGPTが画面のライブビデオキャプチャを表示し、ワークフローを分析できることです。

さらに音声入力にも対応し、新機能「GPT-4o」による音声・ビデオ対話のサポートも予定されています。※新機能「GPT-4o」は後述します。

最新モデル「GPT-4o」 の発表

Youtubeより引用

OpenAI社は5月14日のイベントにおいて、新しいAIモデル「GPT-4o」(omni=全てを意味する)を発表いたしました。GPT-4oは音声、画像、テキストなどさまざまな入力を一度にリアルタイムで処理することができる、まさに”オムニ”なAIモデルです。先述したように無料で活用できます。

GPT-4oの発表について世界と日本でどのように話題になっていたのかを調査・公開したMeltwaterの記事もご覧ください。

【独自調査あり】最新GPT-4oの世界と日本のトレンド|最も関心が高いのは日本?

最新モデル「GPT-4o」とは?

新しいAIモデル「GPT-4o」(omni=全てを意味する)とはいったいなんなんでしょうか。GPT-4との違いが気になると思います。特徴は以下の通りです。

・無料で利用できる

・まるで人間と会話しているような応答速度を実現

・最高レベルのマルチモーダル

・APIにおいてGPT-4oの料金体系を大幅に見直し

・画像生成AIの質向上

・無料で利用できる

経済的で効率的な利用が可能です。APIの処理速度はGPT-4 Turboの2倍で、価格は半分、さらにレート制限も5倍に設定されています。

ChatGPT-4oは、ChatGPT Plusの有料プランに加入することで利用できるようになりました。これまでは無料ユーザーがアクセスできたのはGPT-3.5のみでしたが、今後はGPT-4やGPT-4oも利用可能になるという嬉しい変更点です。

・まるで人間と会話しているような応答速度を実現

これを見てください。面接の準備に挑むためにChatGPTと会話しているシーンですが、こんなに人と会話しているような音声AIを誰が見た事ありますか?

20秒あたりからAIが笑っているのが伺えますw

OpenAIより引用

音声入力に対して、平均で320ミリ秒、最速232ミリ秒という驚異的な応答速度を実現。

これはほぼ人間と会話しているのと同じで、ほぼリアルタイムでの対話が可能です。

・最高レベルのマルチモーダル

もともと急に出てきたGPT-2が前身であるということがわかりました。

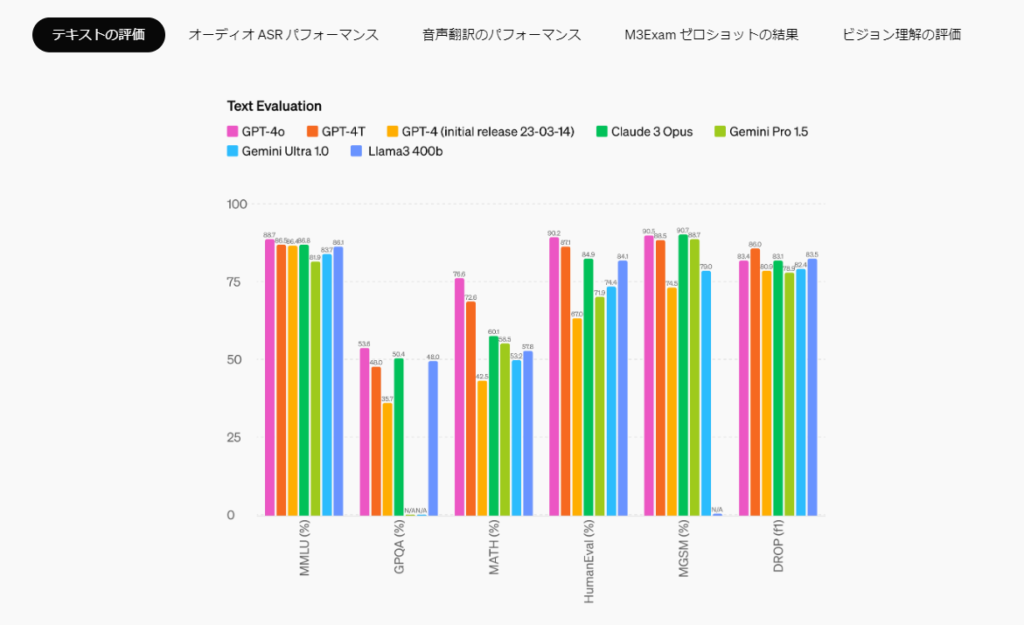

OpenAIより引用

従来のベンチマークで測定したように、GPT-4oはテキスト、推論、コーディング、インテリジェンスに関して GPT-4 Turbo レベルのパフォーマンスを達成すると同時に、多言語、オーディオ、ビジョン機能に関して新たな最高水準を達成しています。上記のグラフは、さまざまな競合AIモデルの総合評価を示しています。

テキストの品質でも最高レベル

OpenAIより引用

MMLU (一般知識の質問) で 88.7% という新たな高スコアを記録しました。

この結果はClaude Opusも凌駕するレべルです。

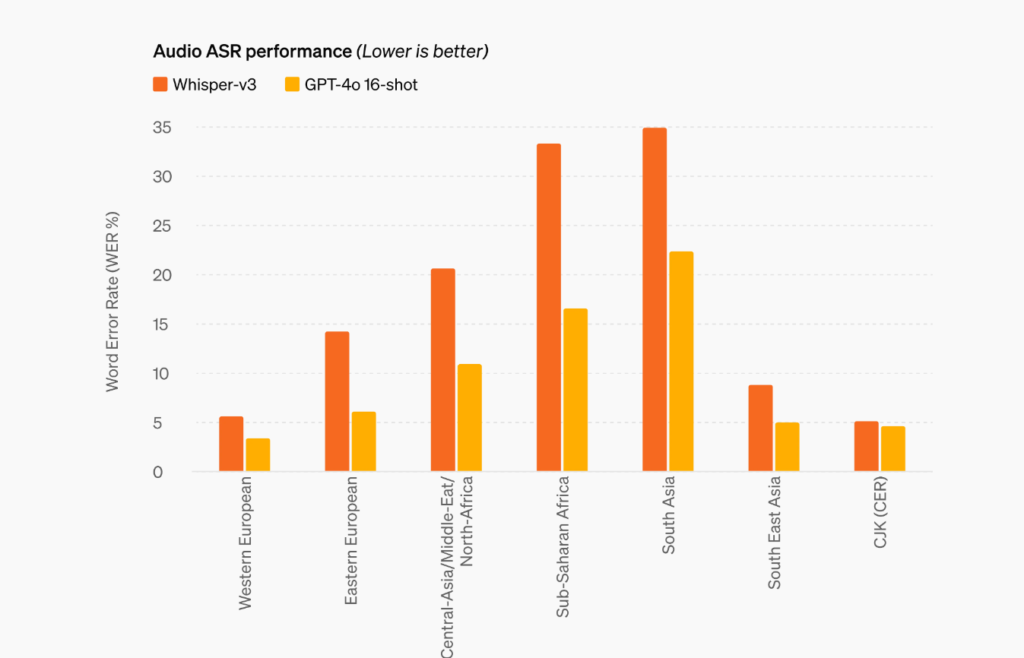

音声認識でも最高レベル

OpenAIより引用

GPT-4oは低リソース言語での音声認識能力が際立っています。

このグラフは、GPT-4oの音声認識性能がWhisper-v3を上回っていることを示しています。特に注目すべきは、低リソース言語、つまりデータが比較的少ない言語での認識精度が大幅に向上していることです。全地域でWhisper-v3を上回る結果を残しており、GPT-4oの低リソース言語対応力の高さがうかがえます。

文脈を読み取る力がエグイということです。

限られたデータからでも高い性能を発揮できるGPT-4oの能力は、多言語対応の音声AIシステム構築に大きく貢献すると期待されています。

音声翻訳のパフォーマンスもエグイ

OpenAIより引用

GPT-4o は音声翻訳において新たな最先端を確立し、MLS ベンチマークで Whisper-v3 を上回ります。

OpenAIより引用

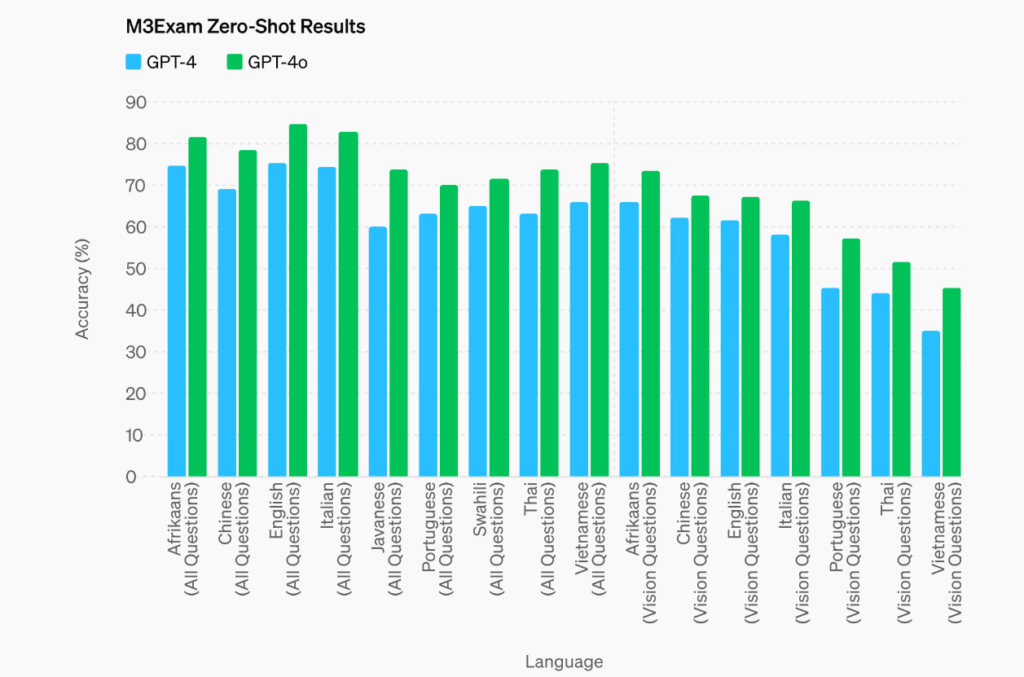

GPT-4oはM3Examベンチマークにおいて、マルチモーダル対応力の高さを示しています。

M3Examは、言語と視覚の両側面を評価するベンチマークです。世界各国の標準テストから出題された多肢選択問題で構成され、図や表なども含まれます。このタスクにおいて、GPT-4oはすべての言語でGPT-4を上回る強力なパフォーマンスを発揮しました。特に視覚情報の理解力が顕著に優れていることがわかります。

GPT-4oが従来のGPT-4を凌駕した大きな理由は、マルチモーダル入力を効果的に処理できる点にあります。テキストだけでなく画像や図表などの視覚情報も的確に解析し、問題解決に活用できるからこそ、高い正解率を残せたと考えられます。

OpenAIより引用

GPT-4oは視覚認識能力においても最先端の性能を発揮しています。

AI2D、ChartQA、DocVQAなどの視覚認識ベンチマークにおいて、GPT-4oは優れた結果を残しています。これらのテストは、画像やチャート、文書画像などの視覚データの理解力を問うものです。GPT-4oがトップレベルのスコアを記録したことから、視覚情報処理能力が大幅に向上していることがうかがえます。

特にAI2Dにおいては、従来モデルから大きく視覚認識精度を上回る点が注目に値します。画像からの物体認識や物体関係性の理解などで卓越しており、GPT-4oの視覚認識の基礎力の高さがうかがえます。

また、チャートやグラフ、文書画像などの高度な視覚データについても、ChartQAやDocVQAで優れたパフォーマンスを発揮しています。単なる物体認識にとどまらず、複雑なビジュアル情報の理解と分析が可能になったことを示しています。

APIにおいてGPT-4oの料金体系を大幅に見直し

| モデル | Input | Output |

|---|---|---|

| GPT-4o | $5 | $15 |

| Claude 3 Opus | $15 | $75 |

| Gemini 1.5 Pro | $7 | $21 |

OpenAIは開発者向けAPIにおいて、GPT-4oの料金体系を大幅に見直しました。GPT-4 Turboと比較して、GPT-4oは2倍の処理速度を実現しながら、価格を半分に抑えることに成功しました。さらに、Rate limitも5倍に拡大されたことで、より多くのリクエストを効率的に処理できるようになりました。

この価格改定により、GPT-4oはライバルであるClaude 3 OpusやGemini 1.5 Proを大きく下回るコストパフォーマンスを実現しました。GPT-4oの料金はClaude 3 Opusの3分の1以下、Gemini 1.5 Proと比べても30%程度の割安感があります。GPT-4oの卓越した性能を考慮すると、この価格設定は市場に対する強気の姿勢を反映していると言えるでしょう。

画像生成AIの質向上

OpenAIより引用

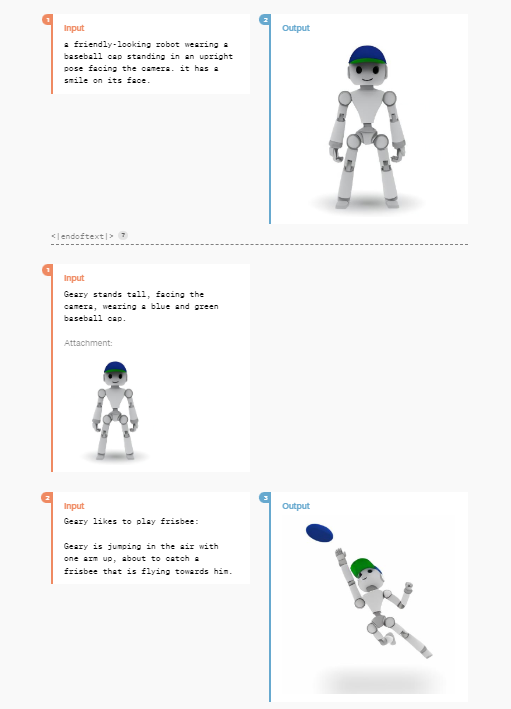

GPT-4oは、視覚的なストーリー生成機能が大幅に向上しました。これまでの画像生成では、一連の画像に一貫性を持たせることが難しく、画像が崩れてしまうことがよくありましたが、今回のアップデートではその問題が改善されています。

例えば、ロボットがタイプライターで日記を書いているシーンなど、多様なビジュアルコンテンツを生成できるようになりました。GPT-4oは、各画像の細部にまで注意を払い、ストーリー全体を通して登場人物やオブジェクトの一貫性を維持することができます。

この機能向上により、GPT-4oは単なる画像生成を超えて、視覚的に豊かで説得力のあるストーリーを紡ぎ出すことができるようになりました。

ChatGPTの画像生成AI機能については以下の記事もご覧ください

「DALL-E 3(DALLE3)」使い方~応用裏技紹介!ChatGPTで画像生成する方法2選!

最新モデル「GPT-4o」の無料・有料での使い方は?

「GPT-4o」無料での使い方

「GPT-4o」の使い方はとっても簡単です。無料・有料とぞれぞれ見え方が違います。

アカウントの登録方法については以下の記事をご覧ください。

無料版の場合はURLに「gpt-4o」と表示されていたら「4o」が使うことが可能です!特に何もしなくても大丈夫です。

「GPT-4o」有料での使い方

おそらくログインすると下記の画面になるかと思います。「今すぐお試しください」を押下します。

もしくはでてこない方でも、下記のように操作することで使えるはずです。

・右上をタップ

・GPT-4o を選択すると活用が可能です!

早速つかってみました。

例えばあえて「「堕罪治」の人間失格について教えて」と打ってみました!

低リソースでもしっかり意図をくみ取り、回答もボリューミーです!すごい。

さらに注目すべきは回答スピードです。「リンゴの万有引力について1000字で記事を書いて」と入れてみました。10秒間で高速に記事を書くGPT-4oのやばさがわかるかと思います。

「GPT-4o」のスマホでの使い方は?

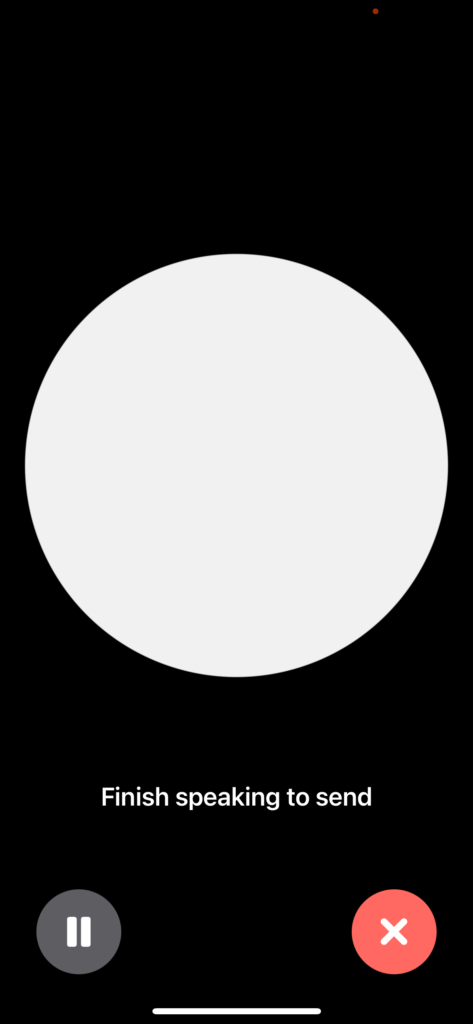

「GPT-4o」のスマホでの使い方はとても楽です。何も設定は必要ありません。

アプリを開いたら以下の左からのステップで操作すればGPT-4oの設定完了です。

実際に使っていきましょう。

・右下のヘッドホンボタンを押下

・左下が再生中(以下のようになっていれば)であれば話かけられます。

「浜田雅功」になりきって話そうと伝えてみました。

早速浜ちゃんになりきってて笑います。

9秒目の「んー」と考えるしぐさに注目してください。これすごくないですか?

スマホでGPT-4oの設定ができない「Error」になる場合

アプリのアップデートをしていないことが原因です。必ずアップデートを終えてから設定するようにしましょう。

【注意点】GPT-4oには使用制限がある

| プラン | GPT-4の利用可能回数 | 利用可能間隔 | 備考 |

|---|---|---|---|

| 無料版 | 1日10回まで | 10回利用後、約5時間 | – |

| Plusプラン | 3時間ごとに最大80回 | 3時間ごと | より頻繁に多くのメッセージ可 |

無料版の場合:

- 1日に10回までGPT-4を連続で使用できます。

- 10回使用後、約5時間の間隔を空けると再度利用可能になります。

Plusプランをご契約の場合:

- 3時間ごとに最大80回のGPT-4の利用が可能です。より頻繁に、たくさんのメッセージのやり取りができますね。

また、現時点ではGPT-4の無料利用は可能ですが、GPT-3.5シリーズ(Davinci, Curie, Babbageなど)は引き続き有料プランでのみ利用できるようです。

OpenAIは徐々にGPT-4の一般ユーザー向け提供を拡大しているようですが、サーバーの負荷などを考慮しながら段階的に行っているのだと思います。今後もGPT-4の利用可能範囲が広がっていくことに期待ですね!ぜひ定期的にOpenAIのアップデート情報をチェックしてみてください。

無料版ではGPT-4oへのアクセスに一日の制限がありますが、有料のPlusとTeamではその制限が大幅に緩和されます。

Plusはパーソナル向け、Teamはビジネスチーム向けの料金体系となっており、GPT-4oの活用用途に合わせて選択できるよう、幅広いラインナップが用意されています。

ChatGPT Team Planの詳細は以下の記事をご覧ください。

GPT-4oでできることは?

OpenAI公式から発表されたGPT-4oでできることを動画と共に紹介します。

リアルタイム翻訳

YOUTUBEより引用

英語とスペイン語をリアルタイムで翻訳しています。これ、もう通訳いらないんじゃ・・・?

実際に海外では外国語学習アプリの株価が大きく下がっています・・・

学習サポートも

YOUTUBEより引用

数学の問題を一緒に解く様子です。ママさんパパさん。子供のためにChatGPTを入れる時代がいよいよ来ています!

障害のある方への有効活用も

Youtubeより引用

音声AIに瞬時に「視界」を把握してもらうことで生活の支えに繋がることがこの動画からわかります。

GPT-4oは無料で使える?料金について

現状ではGPT-4oはChatGPT 有料版に課金している方のみ使うことができます。

しかしながらOpenAI Spring Updateでもあった通り今後はGPT-4と共に一部機能を無料で開放するとされています。

| 特徴 | ChatGPT Free | ChatGPT Plus | ChatGPT Team | ChatGPT Enterprise |

|---|---|---|---|---|

| 対象ユーザー | 個人 | 個人 | 小規模チーム | 大企業 |

| GPTモデル | GPT-3.5 | GPT-4,GPT-4o | GPT-4,GPT-4o | GPT-4,GPT-4o |

| データ保護・プライバシー | 標準 | 標準 | 強化されたデータ保護 | 強化されたデータ保護 |

| 利用制限 | あり | 拡張されたメッセージ上限 | 拡張されたメッセージ上限、時間制限の緩和 | 制限なし |

| 管理機能 | なし | なし | 管理コンソール、チーム管理 | 管理コンソール、チーム管理、SSO、優先サポート |

| カスタマイズ機能 | なし | カスタムGPTの作成と共有 | カスタムGPTの作成と共有(社内共有も有) | カスタマイズされたソリューションへのAPIクレジット |

ChatGPTに課金する方法や有料版と無料版の違いについて知りたい方は下記記事がおすすめです。

【課金】ChatGPT Plus(有料版)の料金や支払い方法について徹底解説

法人利用を検討している方は下記記事もおすすめです。

【ChatGPT Team Plan】とは?メリット~使い方!法人向けに登録・移行方法までを徹底解説

GPT-4oの活用事例を8つ紹介

すでにGPT-4oを活用してSNSで話題となっています。どんな点が優れているのか事例と共に解説していきます。

画像からUIを作成

UIをAIで作成するのが容易になりましたがここまでくるとエグイですね

数学のテストも余裕

一番苦手だった数式へもとうとう解答できるように。

2chのスレッドを再現

2chのスレッドが再現できます。暇つぶしにいいですねw

レシートの認識も

これ、Opusで話題になっていた画像認識機能ですね。GPT-4oでもとうとう精度高く認識できるようになりました。

AIbotに高速でしゃべらせる

これ、動画の速度早めていないんです。本当にAIと友達になれる未来が来るのでは?

DifyからGPT-4oを使う

DifyはRPAのAI版のようなものです。使い方の詳細は下記記事をご参照ください。

漫画の理解もできます

まんがの画像から人物の状況を把握できるのすごくないですか?

画像から食事のカロリーを推定することも

もはやダイエットにGPT-4oは必然に?

GPT-4oの使い方まとめ

- 日時: 2024年5月13日(日本時間14日午前2時)からライブ配信

- 視聴: OpenAIの公式サイト(openai.com)

- 検索エンジン/GPT-5の発表は否定

発表内容まとめ

・安価で利用できる

・まるで人間と会話しているような応答速度を実現

・最高レベルのマルチモーダル

・APIにおいてGPT-4oの料金体系を大幅に見直し

生成AI分野での熾烈な開発競争が続く中、OpenAIの一手次第で今後の潮流が大きく変わる可能性があります。

今すぐChatGPTを始めましょう!

ChatGPTの始め方を3分で解決!スマホとPCに分けて紹介

趣味:業務効率化、RPA、AI、サウナ、音楽

職務経験:ECマーチャンダイザー、WEBマーケティング、リードナーチャリング支援

所有資格:Google AI Essentials,HubSpot Inbound Certification,HubSpot Marketing Software Certification,HubSpot Inbound Sales Certification

▼書籍掲載実績

Chrome拡張×ChatGPTで作業効率化/工学社出版

保護者と教育者のための生成AI入門/工学社出版(【全国学校図書館協議会選定図書】)

突如、社内にて資料100件を毎月作ることとなり、何とかサボれないかとテクノロジー初心者が業務効率化にハマる。AIのスキルがない初心者レベルでもできる業務効率化やAIツールを紹介。中の人はSEO歴5年、HubSpot歴1年